Sur la couverture de l’édition française, en bas à gauche, un éloge de Naomi Klein n’hésite pas à dire du livre qu’il est à lui seul ’un acte d’autodéfense numérique’. En bas à droite de la couverture, on lit aussi ’Plébiscité par The New York Times, The Financial Times, The Guardian et Barack Obama’. Le même Obama au sujet duquel on apprend en avançant dans le livre qu’il a mené ses campagnes électorales avec l’aide d’un certain Eric Schmitt, ancien PDG de Google, afin de cibler massivement les électeurs indécis qui pouvaient pencher en sa faveur [2].

Voilà qui laisse songeur : contre qui peut-il bien nous défendre, ce gros livre, si même Obama l’adoube publiquement ? Plus concrètement, l’approche de Zuboff nous aide-t-elle à y voir plus clair et trouver des failles lorsqu’on veut s’attaquer radicalement au monde de l’économie et du capitalisme ?

Dans un premier temps, nous reprendrons la structure du livre pour y glaner les analyses qui nous semblent pertinentes et permettre à celles et ceux qui n’ont pas le temps de lire le livre d’en avoir une petite idée. Ensuite, on verra pourquoi la critique de Zuboff rate au moins en partie sa cible parce qu’elle se fonde sur un socle pourri dès l’origine.

I. Naissance et apogée du capitalisme de surveillance

« vous avez besoin de gagner, mais vous feriez mieux de gagner en douceur »

Eric Schmitt

Passons la couverture tristement comique et ouvrons le livre. Voici la définition autour de laquelle tourne le livre : ’Le capitalisme de surveillance revendique unilatéralement l’expérience humaine comme matière première gratuite destinée à être traduite en données comportementales. Bien que certaines de ces données soient utilisées pour améliorer des produits ou des services, le reste est déclaré comme un surplus comportemental propriétaire, qui vient alimenter des chaînes de production avancées, connues sous le nom d’ ’intelligence artificielle’, pour être transformé en produits de prédiction qui anticipent ce que vous allez faire, maintenant, bientôt, plus tard. Enfin, ces produits de prédiction sont négociés sur un nouveau marché, celui des prédictions comportementales, que j’appelle les marchés des comportements futurs.’

L’idée générale de Zuboff est relativement simple : après avoir transformé la terre, la monnaie et le travail en marchandises, le capitalisme est en train de faire la même chose avec l’expérience humaine - elle dit même parfois la nature humaine. Comment transforme-t-on de l’expérience en marchandise ? C’est tout l’enjeu des deux premières parties du livre.

A. La naissance du capitalisme de surveillance : le surplus comportemental

Le récit de Zuboff a l’avantage et l’inconvénient de dramatiser ses explications au point de décréter que le capitalisme de surveillance naît précisément en 2001-2002, lorsque des économistes et ingénieurs de Google se rendent compte de la manière dont ils peuvent exploiter les requêtes des utilisateurs pour générer des publicités personnalisées. ’Le capitalisme de surveillance a été inventé par un groupe spécifique d’êtres humains en un lieu et à une époque spécifique. Ce n’est ni un résultat inhérent à la technologie numérique, ni une expression nécessaire du capitalisme de l’information’ [3]. Avantage : resituer précisément les choses, les initiatives, les manœuvres et les stratégies afin de défaire l’image d’un ’système’ et d’une ’technologie’ simplement autonomes et inévitables dans leur déploiement. Inconvénient : réduire tout à quelques idées de génies plus ou moins mal intentionnés et laisser de côté ce qu’il y a de nécessaire et de plus profond dans cette dynamique.

Beaucoup ont relevé avant Zuboff qu’au départ, Google faisait tout pour développer un moteur de recherche qui ne soit pas dévoyé par la publicité. Ces paroles de Sergey Brin et Larry Page en 1998 en témoignent : ’nous sommes convaincus que la question de la publicité suscite assez de motivations mixtes pour qu’il soit crucial de disposer d’un moteur de recherche compétitif qui soit transparent et appartienne au domaine universitaire’ [4]. Sauf que tout se complique très vite : la bulle internet explose, les investisseurs demandent plus de rendements [5], et voilà que les dirigeants demandent aux équipes d’Adwords qui s’occupent de la publicité de trouver des nouvelles sources de recettes. Une foule de brevets est alors déposée en quelques années pour lier les requêtes des utilisateurs à des publicités qui leur correspondent . Évidemment, Google ne s’en tient pas qu’aux requêtes sur son moteur : il se sert de l’ensemble des données qu’il peut recueillir sur un utilisateur afin de cibler au mieux la publicité le concernant, données qu’on nomme les UPI pour user profile information. Cela comprend les données de Google sur toutes les recherches d’un utilisateur mais aussi toutes les données présentes en ligne à son propos : ’ces données peuvent être fournies par l’utilisateur, par un tiers autorisé à les divulguer et/ou dérivées des actions de l’utilisateur. Certaines données peuvent être déduites ou présumées en recourant à d’autres données utilisateur du même utilisateur et/ou d’autres utilisateurs’ [6]. En clair, Google s’approprie tout ce qu’il est possible de savoir sur une personne pour générer des publicités plus pertinentes. Rien de très nouveau mais c’est à partir de ces données que Google découvre et exploite ce que Zuboff appelle le ’surplus comportemental’, pierre de touche du capitalisme de surveillance. Ce surplus désigne la part d’informations sur un utilisateur qui permet d’inférer ses comportements, ses idées, ses intentions. L’image qui revient sans arrêt sous la plume de Zuboff est celle du miroir sans tain derrière lequel des processus automatisés enregistrent nos moindres comportements pour en déduire les suivants et proposer dans l’intervalle aux annonceurs les plus intéressés (et aux plus offrants) de diffuser leurs pubs.

On a entendu mille fois ce refrain et il ne se passe pas une année sans que l’on parle à toutes les sauces de la manière dont Google ou n’importe quelle autre entreprise exploite nos données personnelles. Ce qui est peut-être moins connu, c’est l’affinité entre le surplus comportemental à la Google (l’extraction massive de données) et les intérêts politiques de l’époque pour de telles pratiques. Alors que plusieurs tentatives législatives de limiter la collecte de données personnelles avaient déjà émergées à la fin des années 90, les attentats du 11 septembre 2001 rebattent les cartes. Désormais, toute collaboration entre les services de renseignement et les entreprises privées qui permet d’en savoir le plus possible sur n’importe qui est plus que bienvenue. Dès 1997, le directeur de la CIA, George Tenet, disait : ’La CIA a besoin de nager dans la Valley’. En 99, la société d’investissement In-Q-Tel, financée par la CIA, est ouverte dans la Silicon Valley pour établir des partenariats et grappiller tout ce qui se fait de pertinent en technologies de pointe. Les attaques du 11 septembre ont été ressenties, du point de vu du renseignement américain, comme une humiliation : ils n’étaient pas parvenus à établir les liens permettant d’anticiper les attaques. En 2013, le directeur de la CIA Michael Hayden admet d’ailleurs que l’agence ’pourrait à juste titre être accusée d’avoir militarisé Internet’ [7]. Du point de vue législatif, on note aussi ’qu’avec les attentats du 11 septembre 2001, tout changea. Désormais, la priorité était massivement donnée à la sécurité plutôt qu’à la vie privée’ (Peter Swire, conseiller en chef pour la protection de la vie privée [8]). Dès 2002, un ex-amiral de la NSA, John Poindexter, propose le programme TIA pour Total Information Awareness qui veut se rendre capable de détecter toute information pertinente dans la masse des données mondiales disponibles. En 2003 et 2004, la NSA et la CIA payent Google pour utiliser des services spéciaux d’extraction de données proposés par le moteur de recherche. Plusieurs projets sont entièrement le fruit de coopération ou d’hybridation entre Google et les services de renseignement. C’est le cas par exemple de ’Keyhole’, une entreprise de cartographie acquise par Google en 2004 et dont le bailleur de fond majeur n’était autre que In-Q-Tel : Keyhole deviendra ensuite la colonne vertébrale de Google Earth puis Google Maps ; c’est également le cas de ’Recorded Future’, qui surveille chaque aspect de la toile en temps réel pour prédire les événements futurs et dans laquelle Google et In-Q-Tel ont investit en même temps. Pour récapituler, voici quelques mots de l’ancien directeur de la NSA en 2010, Mike McConnell dans un article du Washington Post, qui devraient donner à penser à tous ceux qui réclament un cyberespace libre et sans frontières :

’Il faut construire un partenariat effectif avec le secteur privé de sorte que les informations puissent circuler rapidement entre public et privé, confidentiel et non-confidentiel [...] pour protéger l’infrastructure déterminante de la nation. De récents comptes rendus sur un possible partenariat entre Google et le gouvernement pointent le type d’efforts communs - et de défis partagés - que nous sommes susceptibles de voir à l’avenir. [...] de tels arrangements brouillent les eaux entre le rôle traditionnel du gouvernement et le secteur privé [...]. Le cyberespace ne connaît pas de frontières, et nos efforts défensifs doivent être, eux aussi, sans coutures’

Cette tendance n’a jamais cessé de se renforcer et il serait vain de chercher à savoir qui en profite le plus entre les entreprises de la Valley et le gouvernement. Passons sur les pages amusantes dans lesquelles Zuboff décrit toutes les stratégies par lesquelles Google fait tout pour maintenir des ’douves autour du château’ ainsi que des ’fortifications’ à coup de rémunérations de travaux universitaires et autre lobbying intensif à Washington. Allons directement à la deuxième étape de la courte histoire du capitalisme de surveillance.

B. L’avancée du capitalisme de surveillance

« Avancez vite et cassez des choses. Si vous ne cassez rien, vous n’avancez pas assez vite ! » Mark Zuckerberg

La deuxième partie de l’ouvrage insiste sur l’approfondissement et la diversification des revenus recherchés par le capitalisme de surveillance. Ces dynamiques reposent en grande partie sur la tendance ubiquitaire de l’informatique, déjà évoquée dans le premier article de notre rubrique [9]. On connaît la fameuse phrase d’Eric Schmitt en 2015 au Forum économique mondial de Davos : ’Internet va disparaître. Il y aura tant d’adresses IP [...], tant d’appareils, de capteurs, d’objets connectés, tant d’éléments avec lesquels on peut interagir qu’on ne s’en rendra même plus compte. Ils feront partie de votre existence en permanence. Imaginez : vous entrez dans une pièce et tout est dynamique !’ [10]. Il n’est pas question de croire sur parole les propos publicitaires de Schmitt, qui ne faisait alors que citer Mark Weiser (’Les technologies les plus profondes sont celles qui disparaissent. [...] Des machines qui s’adaptent à l’environnement des individus au lieu de forcer lesdits individus à s’adapter au leur : voilà qui rend l’emploi d’un ordinateur aussi revigorant qu’une promenade en forêt’, etc). Il s’agit plutôt de faire voir les nouvelles tendances qui permettent de faire de l’argent : vendre des objets connectés ; récupérer des masses de données toujours plus grandes ; exploiter ces données pour fournir des prédictions plus efficaces ; et par ces anticipations prédictives inciter à de nouveaux comportements.

Avant de donner des exemples de ces développements, mentionnons qu’une fois encore, intérêts étatiques et privés ne sont pas étrangers les uns aux autres. Si la surveillance et le renseignement font évidemment partie des fonctions de tout gouvernement qui se respecte, la modification des comportements ou la ’conduite des conduites’ en est depuis longtemps une prérogative essentielle. En revenant sur les vieux dossiers de la CIA dans les années 50, Zuboff rappelle à qui l’aurait oublié que celle-ci avait développé ’une palette de programmes destinée à prédire, à contrôler et à modifier les comportements humains’ [11]. Alors que la guerre de Corée avait popularisé les techniques communistes de ’lavage du cerveau’ qui avaient réduits les prisonniers de guerre américain à l’état de ’robots passifs’ - selon Allen Dules, ancien directeur de la CIA - il fallait donc ’que la CIA s’engage rapidement dans la recherche sur le développement du ’contrôle mental’, ce qui allait de la ’destructuration’ et de la ’reprogrammation’ de l’individu jusqu’à la modification des attitudes et des actions de tout un pays’ [12]. La plupart de ces recherches furent menées dans le cadre du projet MK-Ultra et gardées secrètes car, comme le dit un rapport de l’Inspection Générale en 63 : ’la recherche sur la manipulation du comportement humain est considérée par de nombreuses autorités médicales et apparentées comme une pratique contraire à la déontologie ; par conséquent, la réputation des spécialistes participants au programme MK-Ultra risque d’en souffrir’. Ce n’est que dans les années 70 que les choses seront connues, après une enquête du Sénat. Passé le scandale, ces applications ont tout simplement migré...vers des applications civiles dans toutes sortes d’institutions (écoles, usines, prisons, hôpitaux, etc) [13].

Pas étonnant, dès lors, que ce nouvel état d’esprit se soit largement diffusé au sein du capitalisme de surveillance en quête de nouveaux profits. L’enjeu de cette nouvelle phase est de ne plus se contenter de récupérer des données en ligne, via les requêtes Google des internautes, mais d’aller puiser directement à la source, au contact du réel. Et cette extraction, il s’agira de l’approfondir toujours plus en allant extraire des données toujours plus intimes (on sonde le sommeil, la santé, les humeurs, etc). En plus de ces économies de gamme (élargir le champ des données collectées et leur profondeur intime), le capitalisme de surveillance vise des économies d’action : ’ces interventions sont destinées à améliorer la certitude de prédiction en réalisant un certain nombre d’actions : elles incitent (nudge), elles ajustent (tune), elle aiguillonnent (herd), elles manipulent, elles modifient les comportements dans des directions spécifiques, cela pouvant se traduire par l’insertion d’une expression particulière dans votre fil d’actualité Facebook, l’apparition opportune d’un bouton ACHETER sur votre téléphone ou le blocage programmé de votre voiture lorsque vous avez oublié de régler votre prime d’assurance’ [14]. Comme l’écrit encore Zuboff : ’Avec cette réorientation du savoir vers le pouvoir, automatiser les flux d’information nous concernant ne suffit plus ; le but est désormais de nous automatiser’ [15]. Cela nous rappelle qu’un des dangers de la technologie aujourd’hui n’est pas de faire face sous peu à des machines ’intelligentes’ ou ’autonomes’ mais réside plutôt dans le fait de devenir nous-même des automates à bien des égards. Comme le décrit bien un ingénieur avec lequel Zuboff s’est entretenu : ’Ce n’est plus seulement une question d’informatique ubiquitaire. Le véritable objectif, à présent, c’est l’intervention, l’action et le contrôle ubiquitaires. Le véritable pouvoir, c’est qu’on est maintenant capable de modifier des actions en temps réel dans le monde réel. [...] Des analyses en temps réel qui se traduisent sous des formes d’action en temps réel’ [16].

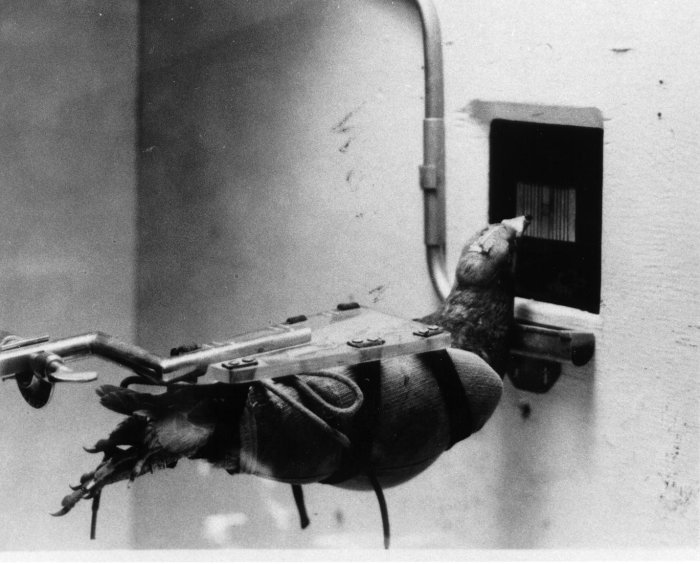

Les exemples de ces manières de modifier et d’influencer les comportements sont légions, d’autant qu’elles existent au moins depuis l’invention de la publicité, si ce n’est depuis toujours mais sous des formes différentes. Zuboff se contente d’en exposer quelques-unes parmi celles qui se sont répandues grâce à la prolifération des données comportementales. Le tuning ou ’ajustement’ implique des ’amorces subliminales destinées à influer subtilement sur le flux comportemental’. Une variante particulièrement en vogue actuellement est le nudge qui se définit par ’tout élément d’une architecture du choix qui modifie le comportement des individus d’une manière prévisible’ [17] (une salle de classe où tout le monde fait face au professeur, un site web qui vous force à accepter telle ou telle condition par son design même, une statistique qui incite à payer vos impôts en vous indiquant innocemment que 90 % des français les payent à temps, etc). Dans le même genre, on trouve également le herding, l’aiguillonnage, qui repose sur un contrôle des éléments du contexte immédiat d’un individu (bloquer le moteur d’une voiture à distance, activer telle ou telle option d’un appareil, etc). ’Nous apprenons à composer la musique ; après quoi, c’est elle qui se charge de les faire danser’, comme l’explique un développeur de logiciels. Troisième genre de technique, le ’conditionnement’, tout simplement : des comportements naturels sont ’sélectionnés’ dans l’environnement immédiat et parviennent au succès. C’est aux expérimentations du behavioriste B.F. Skinner sur les pigeons à Harvard qu’il faut remonter ici : en récompensant les pigeons, il parvenait à ’renforcer’ tel ou tel comportement par rapport à tel autre. Comme le dit un data scientist d’une entreprise de la Silicon Valley interrogé par Zuboff, ’le conditionnement à grande échelle est essentiel à la nouvelle science de l’ingénierie de masse des comportements humains’ [18]. L’avantage des souris de laboratoire, c’est que l’on peut expérimenter sur elles quasi-infiniment. Or, avec les nouveaux outils de collecte et d’analyse de données, ’l’expérimentation peut être automatisée de A à Z’ à en croire les paroles de Hal Varian, l’économiste en chef de Google. Il en va ainsi des expérimentations ’grandeur nature’ de Facebook sur plus de 61 millions de personnes et portant ’l’influence sociale et la mobilisation politique’, menées en 2010. Au cours de cette expérimentation contrôlée et randomisée, ’les chercheurs manipulèrent le contenu social et médiatique des messages électoraux dans les fils d’actualité de près de 61 millions d’utilisateurs de Facebook’ [19]. Un premier groupe voyait un message encourageant à voter en haut du fil d’actualité avec un lien d’information sur la localisation des bureaux de vote, un bouton ’j’ai voté’, le tout accompagné de photos d’amis ayant voté. Les résultats montrent que les utilisateurs ayant reçu le message étaient plus nombreux à cliquer sur le bouton ’j’ai voté’. Au cours d’élections en 2010, on comptait environ 60 000 votants supplémentaires et environ 280 000 autres mus par un effet de ’contagion sociale’, le tout provoqué par ces messages sociaux manipulés. D’autres expériences ont permis de mettre en évidence l’impact affectif de ce qui apparaît sur le fil d’actualité Facebook. Dans un autre genre, un certain Alexandre Kogan, ancien de Cambridge, a réussi à rassembler plus de 270 000 personnes rémunérées pour effectuer des test psychologiques, le tout sans leur dire qu’il avait également accès à leurs profils Facebook. L’opération a permis d’établir des profils psychologiques réels (entre 50 et 87 millions) à partir des données en ligne, lesquels profils ont ensuite été vendus à l’entreprise Cambridge Analytica...dont on connaît désormais le rôle qu’elle a joué dans l’élection de Trump en 2016.

On pourrait continuer ce catalogue des innovations toujours plus poussées pour restituer des informations (voir le projet SEWA qui tentent d’analyser les émotions générées par un programme pour mesurer le degré de satisfaction de l’utilisateur) ou influencer directement les comportements (de la publicité aux horreurs de la CIA jusqu’aux restaurants qui payent Pokemon Go afin de faire venir manger les joueurs près de chez eux) et Zuboff ne s’en prive pas tout au long de cette deuxième partie. Néanmoins, il importe de se défaire de ces accumulations accablantes et parfois grossières où le spectateur indigné fait parfois jeu égal avec le publicitaire mensonger. Mais avant de passer aux critiques, l’intérêt du livre de Zuboff est qu’il propose une tentative de synthèse du nouveau type de pouvoir ou de gouvernementalité qui se dessine au travers de ces pratiques.

C. Du pouvoir instrumentarien pour une troisième modernité

« Nous devons créer un système nerveux pour l’humanité qui puisse consolider nos systèmes sociaux partout sur la planète », Alex Pentland

Dans cette troisième partie, Zuboff s’attaque à l’instrumentarisme qu’elle définit comme ’l’instrumentation et l’instrumentalisation du comportement à des fins de modification, de prédiction, de monétisation et de contrôle’ [20]. Jusqu’ici, rien de nouveau. Elle prétend que le pouvoir « instrumentarien » qui en découle se distingue d’un pouvoir totalitaire auquel on aurait trop facilement tendance à l’associer, en témoigne l’expression de ’Big Brother’ que l’on retrouve partout associée aux nouvelles technologies (reconnaissance faciales, caméras, etc). Le totalitarisme vise avant tout le contrôle des âmes comme l’explique Mussolini dans La Doctrine du fascisme (le fascisme c’est ’l’âme de l’âme [...] Il veut refaire non pas les formes de la vie humaine, mais son contenu’) ou Staline (’C’est ce qui importe, la production des âmes humaines’). Le pouvoir « instrumentarien », lui, vise plutôt les organismes, les corps dans ce qu’ils ont d’extérieur, de concret, les corps comme objets dotés de comportements. On peut douter de cette distinction rigide entre âme et corps et de la catégorie même de totalitarisme qui permet à Zuboff de distinguer les deux pouvoirs, reste qu’elle tire une généalogie plutôt convaincante de l’approche qui permet à une nouvelle rationalité gouvernementale de s’imposer depuis quelques dizaines d’années.

Selon elle, c’est dans le behaviorisme de Skinner qu’il faut chercher la philosophie « instrumentarienne ». Le behaviorisme consiste justement à s’intéresser à des être en les prenant comme des boîtes noires, c’est-à-dire en observant uniquement les comportements extérieurs, visibles, identifiables ’objectivement’. Dans cette approche, il est donc interdit de supposer une âme ou une intention à l’organisme observé. On peut ensuite expérimenter divers types de situations pour voir comment le comportement de l’organisme change ou non (les pigeons à qui l’on donne des récompenses ou des punitions pour voir comment ils réagissent). À partir de là, on peut commencer à établir des règles de comportements sans avoir besoin de notions mal définies comme l’âme, l’esprit ou la volonté. On pourrait juger qu’il s’agit là de préceptes un peu naïfs et peu dommageables, sauf que Skinner en tirait finalement toute une vision du monde et une politique. Selon lui, les notions de liberté ou d’autodétermination n’ont que peu de sens : elles émanent essentiellement du fait que nous ne savons pas ce qui nous détermine. Si je choisis tel candidat, je pense que je le fais parce que je suis libre mais je le fais en réalité parce que j’y suis déterminé pour des raisons qui m’échappent (par exemple parce que Facebook m’incite à le faire). Ce qu’il faut, c’est se doter au maximum des moyens de connaître l’ensemble des causes qui déterminent les humains pour ensuite pouvoir établir des politiques publiques sur la base d’une parfaite rationalité scientifique. On pourrait alors guider l’humanité objectivement vers des cieux meilleurs, eux-mêmes objectivement définis comme ’bons’. Au contraire, des notions comme la liberté, l’autodétermination ou la dignité sont des obstacles qui génèrent de la confusion et de la discorde, empêchant d’avancer dans la bonne direction. Dans un livre justement intitulé Beyond Freedom and Dignity, Skinner écrit : ’Il nous faut accomplir de grands changements dans le comportement humain, et nous n’y parviendrons pas à l’aide des seules sciences de la physiques et de la biologie, avec toute la bonne volonté du monde [...]. Ce dont nous avons besoin, c’est d’une technologie du comportement [...] comparable en puissance et en précision à la technologie physique ou biologique. [21]’

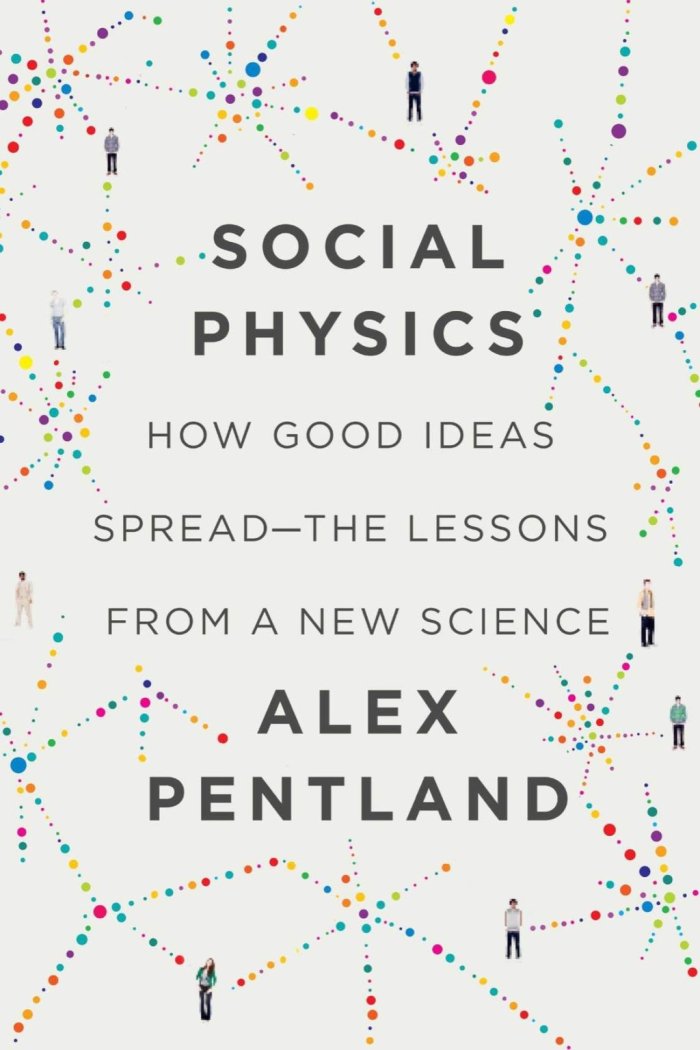

Voilà pour l’héritage. Aujourd’hui, internet et les technologies numériques offrent la possibilité à qui les contrôle de réaliser le programme skinnérien d’une véritable technologie du comportement ou, pour reprendre les mots de ses héritiers comme Alex Pentland, d’une véritable ’physique sociale’. Ce dernier, directeur du Human Dynamics Lab au MIT et auteur d’un livre à succès intitulé Social physics, a justement passé les vingt dernières années à chercher les techniques qui permettaient d’observer et de rationaliser les comportements humains. Parfois surnommé le ’parrain des accessoires connectés’, il conseille toutes sortes d’organisations (Google, Nissan, Telefonica, l’ONU, etc). Alors que Skinner suscitait colère et indignation pour ses positions provocantes, Pentland est plutôt auréolé de gloire et de succès. Alors que Skinner se plaignait du manque d’instruments et de méthodes à sa disposition pour mesurer le comportement humain, Pentland a tout ce qui lui faut à disposition. En 2002, il écrit avec une collaboratrice ’nous avons la conviction que la captation et la modélisation des interactions physiques entre les individus constituent un réservoir non exploité’ [22]. Puis, il développe le ’sociomètre’, sorte de capteur portable permettant d’enregistrer et d’analyser divers types d’informations. En 2005, il développe avec Nathan Eagle la notion d’ ’exploitation du réel’ en utilisant les réservoirs de données que sont les téléphones portables. À partir d’expériences menées sur leurs étudiants, ils montrèrent tout ce qu’il est possible d’apprendre en analysant ces données multiples. En 2009, il réalise des expériences à l’aide d’un badge sociométrique avec des employés de bureau et fonde Sociometric Solutions qui deviendra Humanyze en 2015, qui fournit en badges et conseille un certain nombre de grandes entreprises. Pentland explique d’ailleurs qu’il a convaincu la Bank of America de synchroniser les pauses café afin d’augmenter les interactions entre employés pour augmenter la productivité - il affirme que cela aurait permis une augmentation de productivité de 15 millions de dollars par an [23]. Plus largement, il vise à ’construire des systèmes de gouvernement, de ressources énergétiques et de santé publique efficaces’ grâce à l’analyse de données massives. Pour cela, il ne faut plus réfléchir à l’échelle de l’individu - ’Pentland a compris que ce qui gâche toujours tout, ce sont les individus’ [24]- mais à l’échelle d’un système global, holiste : ’nous avons besoin de repenser de manière radicale les systèmes sociaux. Nous devons créer un système nerveux pour l’humanité qui puisse consolider nos systèmes sociaux partout sur la planète’ [25]. Or, cela est possible puisque, ’pour la première fois dans notre histoire, la plupart des êtres humains sont liés [...] Par conséquent, on peut ’exploiter le réel’ de notre infrastructure de téléphonie sans fil pour [...] contrôler nos environnements et planifier le développement de notre société’.

Ce que l’approche de Pentland indique selon Zuboff, ce sont les signes d’une nouvelle figure du pouvoir qu’elle nomme Big Other, par opposition à Big Brother. Alors que Big Brother incarne une figure personnelle de la surveillance, Big Other représente plutôt une figure automatique, impersonnelle, d’un pouvoir qui repose sur les statistiques et la certitude particulière qu’ils offrent. Quand le premier veut répandre une religion politique totalitaire, l’autre repose l’indifférence radicale des processus algorithmiques, ce que d’autres ont nommé la ’gouvernementalité algorithmique’ [26]. La masse laisse place à la population, la rééducation forcée à l’ingénierie du comportement. Alors que le pouvoir de Big Brother reposerait sur la violence et une théorie qui légitime la pratique, Big Other repose sur la modification douce des comportements et du cadre de vie et les pratiques quotidiennes dissimulent la théorie qui leur est sous-jacente.

Les derniers chapitres du livre de Zuboff décrivent ce pouvoir « instrumentarien » et la ’ruche’ dans laquelle il veut nous faire habiter. C’est un aspect important du livre : il met bien en avant à quel point la rhétorique numérique contemporaine met toujours plus en avant la notion de communauté. Ainsi de Zuckerberg : ’la chose la plus importante que nous puissions faire, c’est développer l’infrastructure sociale [...] construire une communauté globale’ [27]. Les images qui reviennent sans arrêt sous la plume de Zuboff sont celles du troupeau (ce qui n’est pas sans rappeler la fameuse ’immunité de troupeau’ pudiquement traduite par ’immunité collective’ en France), de la ruche, bref de représentations de communautés animales (en vérité plus que discutables) dans lesquelles les comportements mimétiques et automatiques ont submergé l’individu autonome. On trouve d’ailleurs sous la plume d’E. Schmitt et S. Thurn (anciens directeurs de Google et du X lab de Google) l’idée que l’intelligence des machines doit nous inspirer car elle est plus collective que la nôtre : prenez telle voiture autonome, on remarque qu’elle ’apprend’ des erreurs d’une autre voiture situé à des milliers de kilomètres, ce qui n’est pas le cas des humains. Et les deux zozos d’en conclure : ’La leçon que nous enseignent les voitures autonomes, c’est que nous pouvons apprendre et agir de manière plus collective’ [28]. Non seulement les machines ont un mimétisme qui rappelle celui des animaux grégaires, mais en plus il faudrait les imiter pour apprendre à être ensemble. On croît rêver.

Finalement, à rebours d’une tradition qui tente de raccrocher l’autonomie et l’intelligence collective dans le sillage par exemple de l’opéraïsme italien, on trouve ici une opposition nette entre l’autonomie individuelle et la communauté, les deux semblant s’exclure mutuellement. C’est du moins ce qu’en pense Zuboff : ’L’autodétermination et le jugement moral autonome, qu’on aurait tendance à considérer comme des remparts de la civilisation, deviennent à son aune des ennemis du bien collectif. La pression sociale, bien connue des psychologues pour son rôle dangereux dans la production d’obéissance et de conformité, est considérée désormais comme le meilleur moyen d’étouffer les influences prévisibles de la pensée autonome et du jugement moral’ [29]. En lieu et place d’un ’nouveau collectivisme’ [30], il faudrait donc selon Zuboff réinventer une troisième modernité qui fasse la part belle à l’autodétermination, aux humains, aux individus et à la vie privée. ’Que le futur soit numérique, oui, mais avant tout qu’il soit humain’ [31]. C’est pour le moins naïf.

II. Critique de la critique

A. La fable du bon et du mauvais capitalisme

Le premier point de désaccord avec Zuboff se situe sur l’histoire du capitalisme. Son récit laisse penser qu’il y aurait un capitalisme relativement honnête et sain qui aurait dégénéré autour de l’an 2000 à cause de quelques génies de l’informatique et de l’état d’exception instauré après les attentats du 11 septembre. C’est évidemment trop simple. L’ensemble du XXe siècle témoigne contre l’idée qu’il y aurait des techniques neutres que le capitalisme s’accapare seulement dans un deuxième temps. On sait bien que le machinisme est avant tout un prolongement du capitalisme lorsque ce dernier veut accentuer la productivité et se passer d’une main d’œuvre trop onéreuse. Par ailleurs, la surveillance et le contrôle comme enjeux politiques et économiques majeurs apparaissent au moins avec les débuts du capitalisme : déjà au XVIIIe-XIXe siècles il fallait compter et contrôler les marchandises mais aussi surveiller et dresser la main d’œuvre exploitable, tout comme les vagabonds. Inutile de revenir sur tout cela, mais le silence de Zuboff sur ces aspects est étonnant, quand il n’est pas suspect. Elle semble en effet avoir pour le capitalisme industriel ’à la Ford’ un certain respect puisque, dans le modèle de ce dernier, l’intérêt des travailleurs était pris en compte en tant que consommateurs : une partie des gains de productivité réalisés sur les chaînes de montage leur était reversé et ils pouvaient acheter leur voiture à bas prix. Tout faisait système et semblait profiter à tout le monde. En réagissant à une demande sociale réellement existante et en la réalisant, Ford restait finalement dans un échange de bons procédés : ’l’invention de Ford approfondissait les relations de réciprocité entre le capitalisme et ces populations. Les inventions de Google, en revanche, détruisirent les relations de réciprocité inscrites dans son contrat originel avec les utilisateurs’ [32]. C’est peu de dire que cette approche nous semble aberrante quand on pense aux cadences imposées et aux formes de vie infernales des ouvriers de la grande industrie fordiste (évoquées dans le second article de cette rubrique [33]).

L’opposition entre un capitalisme industriel et un capitalisme de surveillance numérique est également trompeuse car l’industrie n’a jamais disparu sous le régime du capitalisme de surveillance. C’est ce que doivent toujours dissimuler les approches universitaires qui tiennent à faire valoir leur concept comme clef de lecture de l’époque : la persistance des anciens modèles et des anciennes formes. Et cela à bien des égards. Zuboff écrit par exemple : ’Le capitalisme industriel reposait sur l’exploitation et le contrôle de la nature - les conséquences sont catastrophiques, ce dont nous ne prenons conscience que maintenant. Quant au capitalisme de surveillance, il se structure, comme je l’ai suggéré, sur l’exploitation et le contrôle de la nature humaine’ [34]. En fait, l’exploitation et le contrôle de la nature n’ont jamais cessé pour la bonne et simple raison que le capitalisme actuel, de même qu’internet et le secteur du numérique, reposent aussi sur l’industrie. Ils reposent sur l’extraction de matière premières relativement rares et une dépense d’énergie énorme. Les productions s’additionnent sans cesse et on continue éperdument le saccage du monde. Mais ce qui est vrai pour le monde vaut également pour la nature humaine. Un peu de Marx ne fait pas de mal : il n’y a pas de nature humaine en dehors d’une relation avec un monde matériel. Si le capitalisme industriel détruisait la ’nature’, c’est que d’une manière ou d’une autre il saccageait également le tissu éthique des humains qui vivaient en son sein. La destruction des communautés traditionnelles, l’industrialisation, les guerres mondiales, la bombe atomique, la société de consommation, tout cela ne compte-t-il pas tout autant comme une vaste destruction de monde pour les personnes concernées et leurs descendants ?

B. Le droit et le confort bourgeois comme socles de la ’critique’

Au-delà de l’analyse du capitalisme, c’est dans la vision plus générale du monde que notre vision diverge radicalement de celle de Zuboff. Selon elle, le capitalisme de surveillance remet en cause en 20 ans ce qui a mis des années à se constituer : ’cette vision nouvelle de par sa dynamique menace des systèmes - sociétaux et psychologiques, cette fois, et fragiles - qui ont mis des milliers d’années pour arriver à une certaine maturité, des milliers d’années de souffrances et de conflits humains : ces systèmes, nous les appelons perspective démocratique et accomplissement de l’individu comme source de jugement moral et autonome’ [35]. Tout se passe donc comme si la civilisation était arrivé à la ’fin de l’histoire’ vers les années 90 et que quelques ingénieurs de chez Google avaient tout gâché. C’est évidemment une caricature de la pensée de Zuboff, mais le désaccord persiste devant l’idée d’un ’produit fini’ de la civilisation qu’il s’agirait de sauvegarder. Et pour cause, le ’produit fini’ en question n’est autre que l’individu autonome qui, a bien des égards, est plus un problème qu’autre chose, précisément parce qu’il est la cause et la conséquence d’un capitalisme destructeur. Il est bien impossible de le jeter par dessus bord et il faudrait y consacrer une entière discussion, mais nous ne pensons pas qu’il soit un levier suffisant ou pertinent pour s’opposer aux logiques technologiques et économiques actuelles puisqu’il est en réalité le résultat du processus capitaliste lui-même. L’usager individuel est aussi bien le produit (comme objet) de l’extraction de données personnalisées qu’il n’est produit (comme sujet) par ce processus même. Pas question non plus de brandir son opposé, le ’collectif’ ou la ’communauté’, dont on a vu avec Zuboff que le capitalisme de surveillance les utilisait aussi pour son compte. Il conviendrait plutôt de diviser à nouveau ces entités et l’opposition binaire qu’elles composent pour examiner soigneusement ce dont nous désirons hériter. Mais c’est une autre histoire.

La téléologie de Zuboff la pousse donc à la défense d’une sorte de socle éthico-politique tout simple, tout nu, tout bourgeois : l’individu et sa vie privée. D’ailleurs, l’un des ’mythes’, assumé comme tel, qui revient sans arrêt comme contrepoint critique dans le livre de Zuboff est le ’chez soi’, le ’sanctuaire’, le ’refuge’ dont elle donne un exemple concret au travers de l’Aware Home. C’est le nom d’un projet d’ingénieurs et informaticiens de Georgia Tech, en 2000, qui imaginèrent ’une ’symbiose humain-maison’ dans laquelle de nombreux processus animés et inanimés seraient captés par un réseau complexe de ’capteurs sensibles au contexte’ intégrés à la maison et par les objets connectés que portent ses occupants.’ Le tout avec 3 hypothèses de travail : ce genre de système ouvre un champ du savoir complètement nouveau ; ce savoir et le pouvoir qu’il confèrent doivent appartenir et servir aux habitants de la maison ; cette nouvelle maison numérique resterait un ’chez-soi’, un sanctuaire privé pour les habitants [36]. Ce modèle de l’Aware Home, Zuboff le brandira à nouveau pour montrer le modèle de ce qu’elle désire : un chez soi numérique dont les données ne fuitent pas. Las, elle enchaîne ensuite sur le business actuel que représente la maison connectée, soit autour de 151 milliards de dollars en 2023.

Au contraire de Zuboff, nous n’avons pas envie de cette bulle privée numérique, que les données générées soient exploitées ou non par les grands méchants GAFAM (à ce propos, on notera que Zuboff se concentre essentiellement sur Google, Facebook, Microsoft et un peu Amazon, comme si Apple, évoqué rapidement au début, représentait un futur numérique plus ’humain’). D’abord parce qu’elle contribue à mettre à distance le monde réel, social. Ensuite parce qu’elle continuera à reposer sur des technologies dévastatrices, suffisamment éloignées du chez-soi rassurant. Enfin parce qu’il nous semble que cette bulle privée n’est pas pour rien dans l’impuissance toute particulière générée par le capitalisme numérique. Comme tout ce qui repose sur la conscience et la critique, la stratégie politique de Zuboff mise fondamentalement sur l’indignation : il s’agit de sortir de l’engourdissement, de retrouver une capacité de stupéfaction, etc. Ceci n’est pas rien, mais il est aussi probable que le capitalisme numérique tolère tout à fait ce genre de discours, surtout lorsqu’ils sont écrit ou lu derrière des écrans. D’ailleurs, la plupart des mécanismes exposés ici, on les connaît déjà plus ou moins et il n’est pour autant évident de s’y rapporter, surtout lorsque, comme Zuboff, on les attribue à quelques grandes et lointaines entreprises. Zuboff apporte donc un peu de clarté en exposant dans le détail des stratégies clairement ’ennemies’ qui préfèrent souvent rester secrètes, mais elle apporte elle aussi, à son tour, son lot d’impuissance, une sorte d’indignation muette et difficile à convertir en autre chose qu’elle même.

Vous pouvez trouver les autres articles de la rubrique cyber-philo-technique sur notre site :

1. De la cybernétique à l’informatique ubiquitaire

2. Du code-barre au QR-code

3. Câbles sous-marins et internet mondial